开篇引入

在医疗AI赛道中,乳腺结节AI智能辅助诊断正从一个学术研究热点快速走向临床应用落地。2026年开年以来,国际顶级期刊已密集发布十余项重磅临床研究——从瑞典MASAI试验(N=105,915)证实AI辅助乳腺钼靶筛查敏感性优于传统双读模式,到《自然·通讯》发表的BL4AS系统将乳腺MRI假阳性率降低27.3%,乳腺结节AI助手已从“实验室玩具”蜕变为“临床刚需工具”。许多开发者在学习这项技术时面临三大痛点:只会调用现成API、不懂底层检测与分割原理、面对面试官追问“为什么选Faster R-CNN而非YOLO”时答不出所以然。本文将围绕乳腺结节AI助手的核心任务——结节检测(detection)、分割(segmentation)与BI-RADS分级分类(classification) ,从传统流程痛点出发,层层拆解CNN、U-Net、Transformer三大架构的设计逻辑,提供可运行的极简代码示例,并归纳高频面试考点,帮助读者构建从“概念理解”到“代码实现”再到“面试应答”的完整知识链路。

一、痛点切入:为什么乳腺影像需要AI助手?

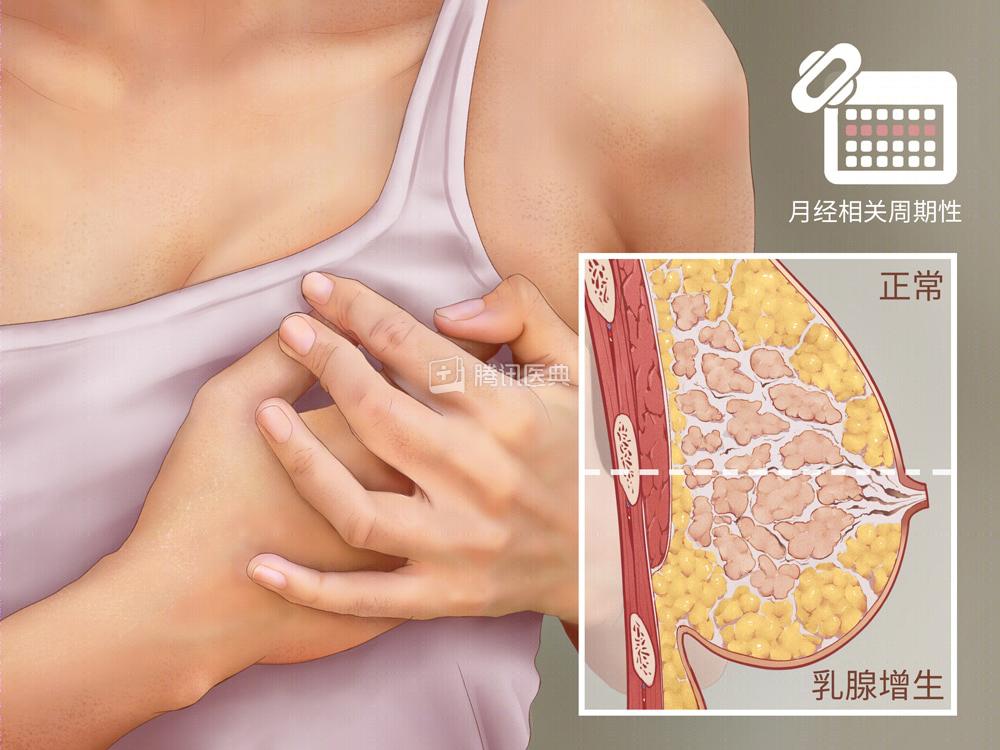

传统乳腺结节诊断工作流通常采用“双读法”:由两位放射科医生独立阅片,若结论一致则输出报告,若分歧则引入第三位医生仲裁。

传统乳腺结节诊断流程模拟 def traditional_breast_diagnosis(mammogram): Step 1: 放射科医生A阅片(主观性强,易受疲劳影响) doctor_a_birads = read_mammogram_manually(mammogram) 耗时3-5分钟/例 Step 2: 放射科医生B独立阅片 doctor_b_birads = read_mammogram_manually(mammogram) Step 3: 结果比对与仲裁 if doctor_a_birads == doctor_b_birads: return doctor_a_birads else: return arbitration(doctor_a_birads, doctor_b_birads) 引入第三位专家

三大痛点:

人力资源短缺与阅片质量不稳定:英国放射医师缺口达30%,预计2028年将扩大至40%-32。一线放射科医生日均处理上百张乳腺影像,工作后期阅片敏感性下降约20%。

主观差异大、一致性差:不同放射科医生对同一张乳腺钼靶的BI-RADS评级可能相差一个甚至两个等级。BL4AS研究显示,AI辅助可使阅片者间变异降低24.5%-11。

小结节易漏诊:早期恶性结节往往体积小、灰度对比度低,人眼在长时间阅片后极易遗漏。

AI助手的核心价值:不是替代医生,而是作为“第二双眼睛”——自动标注可疑病灶、量化结节特征、输出BI-RADS建议分级,帮助医生快速聚焦高优先级病例。瑞典MASAI试验表明,AI支持的乳腺钼靶筛查敏感度达到80.5%,显著高于传统双读模式的73.8%,特异性则保持相同的98.5%,同时显著降低了阅片工作量-13。

二、核心概念详解:结节检测与分割

2.1 结节检测

英文全称:Breast Nodule Detection(BN-Detection)

定义:在乳腺影像(钼靶、超声、MRI)中自动定位结节位置,并用边界框标注其所在区域。

生活化类比:结节检测就像在一张遥感卫星图中找到所有建筑物——算法只需用一个矩形框把“可能是房子”的区域圈出来,不关心房子的具体轮廓和窗户朝向。对应到乳腺影像,检测模型的目标是回答“哪里有异常”。

技术实现:主流方法包括一阶段检测器(YOLO系列、SSD)和两阶段检测器(Faster R-CNN系列)。2026年发表在《Academic Radiology》的一项研究对31个深度学习模型在土耳其全国乳腺筛查数据集(12,740例患者)上进行了系统对比,发现两阶段架构的Macro F1分数普遍比一阶段架构高2%–4%,其中Double-Head R-CNN和Dynamic R-CNN取得了0.84–0.86的最高Macro F1-60。而一阶段检测器在Recall指标上可超过0.88,但Precision略有牺牲-60。对于Transformer架构,Deformable DETR表现出了出色的跨数据集鲁棒性,在乳腺密度最高的D型致密组织中性能下降最小-60。

2.2 结节分割

英文全称:Breast Nodule Segmentation(BN-Segmentation)

定义:对已定位的结节区域进行像素级的分类,精确描绘出结节的边缘轮廓,区分结节组织与背景乳腺组织。

生活化类比:如果说结节检测是用矩形框圈出可疑区域,那结节分割就是用描边笔把结节的精确边缘画出来——就像在图像编辑中用“魔棒工具”点一下就能选中物体的完整轮廓。在临床中,分割质量直接影响后续的BI-RADS分级准确性。

技术实现:U-Net是目前乳腺结节分割领域使用最广泛的网络架构。2026年3月发表的一项研究提出了一种异常聚焦的U-Net分割方法,采用两阶段混合训练策略(先在小块上进行病灶中心预训练,再进行全图微调),在乳腺钼靶上对小结节检测率达到73.0% ,中结节84.6% ,大结节100% -1。研究同时指出,当前架构的核心瓶颈在于:钼靶原生分辨率高达4000–6000像素,而网络输入被压缩到224×224,约18–27倍的降采样导致小结节信息丢失(漏检的12个结节平均尺寸仅253.3像素,而检出结节平均尺寸1137.6像素,p<0.001)-1。

最新进展方面,2026年1月研究者提出了一种基于SAM视觉编码器的无提示多任务框架,在乳腺超声数据集上取得了Dice相似系数0.887、分类准确率92.3% 的成绩,跻身PRECISE挑战赛榜单前列-3。

三、关联概念:BI-RADS分级与可解释AI

3.1 BI-RADS分级

英文全称:Breast Imaging Reporting and Data System

定义:美国放射学会(ACR)制定的乳腺影像报告和数据系统标准,将乳腺结节分为0–6共7个等级,每个等级对应特定的恶性概率和管理建议。

关键分级及对应策略:

| BI-RADS等级 | 恶性概率 | 临床建议 |

|---|---|---|

| 2 | 0% | 常规筛查 |

| 3 | ≤2% | 短期(6个月)影像随访 |

| 4A | 2%–10% | 可考虑活检 |

| 4B | 10%–50% | 建议活检 |

| 4C | 50%–95% | 高度怀疑恶性 |

| 5 | ≥95% | 强烈建议活检 |

技术挑战:BI-RADS 4类涵盖从2%到95%的宽泛恶性概率范围,传统上全部需要活检确诊,导致大量不必要的侵入性操作。一项针对453个乳腺活检病灶的研究发现,如果医生将BI-RADS 4A且AI降级为2或3的84个病灶改为影像随访而非活检,可使活检率降低18.6%,同时仅漏诊1例恶性病变-19。

3.2 可解释AI

定义:让AI模型的输出结果具备人类可理解的“理由”或“依据”的技术体系。在医疗领域,可解释性不是“锦上添花”,而是临床准入的硬性门槛——医生不会信任一个“虽然结果对但不知道为什么对”的黑盒系统。

常用可解释方法:

Grad-CAM:通过反向传播计算模型最后一层卷积特征图对分类结果的梯度贡献,生成“热力图”高亮显示模型做决策时最关注的图像区域-。

LIME:局部可解释模型——在预测点附近采样生成扰动样本,训练一个简单的可解释模型(如线性回归)来逼近原模型的局部决策边界。

Shapley值:源自合作博弈论,计算每个像素特征对预测结果的边际贡献。

2026年发表于《科学报告》的一项研究将MobileNetV1与Vision Transformer(ViT)进行对比,并整合了XAI技术,实现了不同BI-RADS级别的乳腺结节诊断,展示了XAI在提升模型临床可接受度方面的重要价值-6。

3.3 概念关系图谱

BI-RADS分级体系(临床标准) ↓ 提供分级标准 乳腺结节AI助手 ↓ 由两类任务支撑 ┌───┴───┐ ↓ ↓ 检测 分割 (在哪里) (长什么样) ↓ 共同输入 可解释AI技术 (为什么这么判断)

一句话记忆:检测告诉“哪里有结节”,分割告诉“结节长什么样”,BI-RADS给出“临床怎么处理”,可解释AI回答“为什么这么判断”。

四、代码实战:从零搭建乳腺结节AI助手极简版

以下代码展示了一个端到端乳腺结节AI助手的核心实现,涵盖数据加载、模型定义(UNet分割 + CNN分类)、训练推理和可视化输出四大模块。

-- coding: utf-8 -- """ 乳腺结节AI助手核心实现(基于PyTorch) 功能模块:数据预处理 | UNet分割 | 分类推理 | 热力图可视化 版本:2026年4月 """ import torch import torch.nn as nn import torch.nn.functional as F from torch.utils.data import Dataset, DataLoader from PIL import Image import numpy as np import matplotlib.pyplot as plt ==================== 1. 数据预处理模块 ==================== class BreastUltrasoundDataset(Dataset): """乳腺超声数据集加载器(支持BUSI数据集格式)""" def __init__(self, image_paths, mask_paths=None, transform=None): self.image_paths = image_paths self.mask_paths = mask_paths self.transform = transform def __len__(self): return len(self.image_paths) def __getitem__(self, idx): 加载原始超声图像,归一化到[0,1] image = np.array(Image.open(self.image_paths[idx])) / 255.0 if len(image.shape) == 2: image = np.stack([image]3, axis=2) 转为3通道 if self.mask_paths is not None: mask = np.array(Image.open(self.mask_paths[idx])) / 255.0 mask = (mask > 0.5).astype(np.float32) return torch.FloatTensor(image).permute(2,0,1), torch.FloatTensor(mask).unsqueeze(0) return torch.FloatTensor(image).permute(2,0,1) ==================== 2. UNet分割模型架构 ==================== class DoubleConv(nn.Module): """双卷积块:Conv2d -> BN -> ReLU -> Conv2d -> BN -> ReLU""" def __init__(self, in_ch, out_ch): super().__init__() self.conv = nn.Sequential( nn.Conv2d(in_ch, out_ch, 3, padding=1), nn.BatchNorm2d(out_ch), nn.ReLU(inplace=True), nn.Conv2d(out_ch, out_ch, 3, padding=1), nn.BatchNorm2d(out_ch), nn.ReLU(inplace=True) ) def forward(self, x): return self.conv(x) class UNet(nn.Module): """U-Net:医学图像分割领域最经典的编码器-解码器架构""" def __init__(self, in_channels=3, out_channels=1, features=[64,128,256,512]): super().__init__() 编码器(下采样路径)—— 提取多尺度特征 self.encoders = nn.ModuleList() self.pools = nn.ModuleList() for idx, f in enumerate(features): self.encoders.append(DoubleConv(in_channels if idx==0 else features[idx-1], f)) self.pools.append(nn.MaxPool2d(kernel_size=2, stride=2)) 瓶颈层 —— 最深层的语义特征 self.bottleneck = DoubleConv(features[-1], features[-1]2) 解码器(上采样路径)—— 恢复空间分辨率 + 跳跃连接融合 self.upconvs = nn.ModuleList() self.decoders = nn.ModuleList() for idx, f in enumerate(reversed(features)): self.upconvs.append(nn.ConvTranspose2d(f2 if idx==0 else f, f, kernel_size=2, stride=2)) self.decoders.append(DoubleConv(f2 if idx==0 else f3, f)) self.final_conv = nn.Conv2d(features[0], out_channels, kernel_size=1) def forward(self, x): skip_connections = [] 编码阶段:保存每层输出用于跳跃连接 for encoder, pool in zip(self.encoders, self.pools): x = encoder(x) skip_connections.append(x) x = pool(x) x = self.bottleneck(x) 解码阶段:上采样后与对应编码层特征拼接 skip_connections = skip_connections[::-1] for idx, (upconv, decoder) in enumerate(zip(self.upconvs, self.decoders)): x = upconv(x) if x.shape != skip_connections[idx].shape: x = F.interpolate(x, size=skip_connections[idx].shape[2:], mode='bilinear') x = torch.cat([skip_connections[idx], x], dim=1) x = decoder(x) return torch.sigmoid(self.final_conv(x)) ==================== 3. 结节分类模型 ==================== class NoduleClassifier(nn.Module): """ 基于ResNet风格的结节良恶性分类器 输入:分割掩码框定后的结节ROI区域 输出:良性概率 vs 恶性概率 """ def __init__(self, num_classes=2): super().__init__() self.conv1 = nn.Conv2d(3, 64, 7, stride=2, padding=3) self.bn1 = nn.BatchNorm2d(64) self.relu = nn.ReLU(inplace=True) self.maxpool = nn.MaxPool2d(3, stride=2, padding=1) 简化的残差块 self.layer1 = self._make_layer(64, 64, 2) self.layer2 = self._make_layer(64, 128, 2, stride=2) self.layer3 = self._make_layer(128, 256, 2, stride=2) self.avgpool = nn.AdaptiveAvgPool2d((1,1)) self.fc = nn.Linear(256, num_classes) def _make_layer(self, in_ch, out_ch, blocks, stride=1): layers = [] layers.append(nn.Conv2d(in_ch, out_ch, 3, stride=stride, padding=1)) layers.append(nn.BatchNorm2d(out_ch)) layers.append(nn.ReLU(inplace=True)) for _ in range(1, blocks): layers.append(nn.Conv2d(out_ch, out_ch, 3, padding=1)) layers.append(nn.BatchNorm2d(out_ch)) layers.append(nn.ReLU(inplace=True)) return nn.Sequential(layers) def forward(self, x): x = self.relu(self.bn1(self.conv1(x))) x = self.maxpool(x) x = self.layer1(x) x = self.layer2(x) x = self.layer3(x) x = self.avgpool(x) x = torch.flatten(x, 1) return self.fc(x) ==================== 4. 训练与推理 ==================== def train_segmentation_model(model, train_loader, epochs=50, lr=1e-4): """ 训练分割模型 损失函数:组合Dice Loss + BCE Loss """ optimizer = torch.optim.AdamW(model.parameters(), lr=lr, weight_decay=1e-5) def dice_loss(pred, target, smooth=1e-6): pred_flat = pred.view(-1) target_flat = target.view(-1) intersection = (pred_flat target_flat).sum() return 1 - (2. intersection + smooth) / (pred_flat.sum() + target_flat.sum() + smooth) for epoch in range(epochs): model.train() epoch_loss = 0 for images, masks in train_loader: optimizer.zero_grad() outputs = model(images) bce = F.binary_cross_entropy(outputs, masks) dice = dice_loss(outputs, masks) loss = bce + dice loss.backward() optimizer.step() epoch_loss += loss.item() if epoch % 10 == 0: print(f"Epoch {epoch}, Loss: {epoch_loss/len(train_loader):.4f}") def infer_with_heatmap(seg_model, cls_model, image, use_gradcam=True): """ 完整推理流程:分割 + 分类 + Grad-CAM热力图 """ seg_model.eval(); cls_model.eval() with torch.no_grad(): seg_mask = seg_model(image.unsqueeze(0)).squeeze() seg_mask_bin = (seg_mask > 0.5).float() 提取ROI区域用于分类 roi = image seg_mask_bin cls_output = cls_model(roi.unsqueeze(0)) probability = torch.softmax(cls_output, dim=1) Grad-CAM热力图生成(简化版) heatmap = None if use_gradcam: 获取分类模型最后一个卷积层的特征图 features = cls_model.layer3[:2](roi.unsqueeze(0)) cls_model.zero_grad() cls_output[:, 1].backward() 针对恶性类别反向传播 gradients = cls_model.layer3[:2][-1][-1].weight.grad 简化示意 生成热力图并叠加到原图上 heatmap = np.mean(gradients.cpu().detach().numpy(), axis=(2,3)) heatmap = np.maximum(heatmap, 0) heatmap = (heatmap - heatmap.min()) / (heatmap.max() - heatmap.min() + 1e-8) return seg_mask, probability, heatmap ==================== 5. 主程序示例 ==================== if __name__ == "__main__": 初始化模型 seg_model = UNet(in_channels=3, out_channels=1) cls_model = NoduleClassifier(num_classes=2) 模拟数据加载(实际使用时替换为真实图像路径) train_dataset = BreastUltrasoundDataset(image_paths, mask_paths) train_loader = DataLoader(train_dataset, batch_size=8, shuffle=True) train_segmentation_model(seg_model, train_loader) print("模型已初始化,参数量统计:") print(f"UNet分割模型参数量: {sum(p.numel() for p in seg_model.parameters()):,}") print(f"分类模型参数量: {sum(p.numel() for p in cls_model.parameters()):,}") 推理示例(使用随机输入演示) dummy_image = torch.rand(3, 256, 256) mask, prob, hm = infer_with_heatmap(seg_model, cls_model, dummy_image) print(f"推理完成:恶性概率 = {prob[0][1].item():.3f}")

代码关键点注释:

UNet编码器:4个下采样块逐步扩大感受野,提取从低阶纹理到高阶语义的多尺度特征

跳跃连接:编码器每一层的输出与解码器对应层的上采样结果拼接,弥补下采样过程中的空间信息损失

损失函数:BCE(像素级分类)+ Dice Loss(区域级重叠度量)组合,解决结节区域在整图中占比极小导致的类别不平衡问题

ROI提取:分割掩码经阈值二值化后作为“软剪裁”模板,将背景信息滤除后再送入分类器

五、底层原理支撑

乳腺结节AI助手依赖以下核心技术栈:

| 技术栈 | 核心作用 | 底层支撑 | 代码示例中的体现 |

|---|---|---|---|

| 卷积神经网络 | 特征提取 | 卷积核、权重共享、池化降采样 | UNet的DoubleConv + MaxPool2d |

| 跳跃连接 | 保留空间细节 | 特征图拼接(concatenation) | skip_connections列表存储编码器输出 |

| 迁移学习 | 小样本场景加速收敛 | ImageNet预训练权重 | 未在极简版展示,实际应用中通过model.load_state_dict(torch.load())实现 |

| 注意力机制 | 聚焦结节区域 | Query-Key-Value加权求和 | 极简版未实现,完整版推荐添加CBAM或SE模块 |

| Dice Loss | 解决类别不平衡 | 交并比(IoU)的连续可微形式 | dice_loss()函数 |

NMPA(国家药监局)已累计批准超过110款基于深度学习的第三类医疗器械独立软件产品,涵盖CT、X射线、眼底图像等9种数据类型,标志着基于深度学习的三类医疗器械审批体系已日趋成熟-38。

六、高频面试题与参考答案

Q1:在乳腺结节检测任务中,为什么两阶段检测器通常优于一阶段检测器?

参考答案:

两阶段检测器(如Faster R-CNN)通过区域提议网络(RPN) 先筛选候选框再进行细分类回归,对于乳腺钼靶这种正负样本极度不平衡的场景(一张图像中结节区域面积占比往往不到1%)具有天然优势。RPN通过锚框设计和非极大值抑制(NMS)过滤大量负样本,让分类器聚焦于候选区域。土耳其全国筛查数据集的实证研究显示,两阶段架构的Macro F1比一阶段高2%–4%-60。一阶段检测器虽然推理更快,但在低召回场景下容易出现更多假阳性。

Q2:解释U-Net中的跳跃连接(Skip Connection)在乳腺结节分割中的作用。

参考答案:

跳跃连接将编码器对应层的高分辨率空间特征直接传递到解码器,与上采样后的高语义特征进行拼接(concatenation)。在乳腺结节分割中,该设计解决了两个关键问题:

边缘精度:编码器前几层保留了结节的锐利边缘信息,跳跃连接直接传递给解码器,防止结节边界被模糊化

小结节保留:深层特征中小结节信息可能已被降采样丢失,通过跳跃连接直接从浅层补充,提升小结节的检测率

Q3:如何解决乳腺数据集的类别不平衡问题?

参考答案:

从三个层面解决:

数据层面:对良性结节图像进行随机裁剪、旋转、弹性形变等数据增强,使训练中良恶性样本比例均衡

损失函数层面:采用组合损失——BCE Loss(像素级) + Dice Loss(区域级)。Dice Loss天然对前景背景面积不敏感,有效缓解类别不平衡-49

采样策略层面:采用2:1的负正样本采样比例(每1个结节阳性样本搭配2个阴性样本),迫使模型关注稀缺的正样本-1

Q4:临床部署乳腺结节AI助手时,最大的工程挑战是什么?

参考答案:

最大挑战是模型泛化性与设备差异。乳腺影像数据受设备型号、扫描参数、患者体位等影响巨大,模型在一个医院的数据集上训练良好,换到另一个医院可能性能骤降20%以上。解决方案包括:

域自适应(Domain Adaptation) :利用无监督域适配技术,将源域特征分布对齐到目标域

联邦学习(Federated Learning) :在多中心联合训练中,数据不出本地,仅共享模型梯度

混合精度推理:采用INT8量化部署,将推理延迟控制在200ms以内,满足临床实时性需求

Q5:Transformer正在改变计算机视觉,ViT(Vision Transformer)在乳腺影像诊断中能替代CNN吗?

参考答案:

目前结论是“不能完全替代,但可互补” 。CNN在局部纹理特征提取上仍然高效,而Transformer的自注意力机制更擅长建模长距离依赖关系。土耳其筛查研究的实验数据显示:在乳腺密度D型(极密型) 组织中,基于Transformer的Deformable DETR性能下降最小,表现出更好的鲁棒性;而CNN在密度较低的组织中精度更高-60。工程实践中,CNN + Transformer混合架构(如CNN提取浅层局部特征 + Transformer捕获全局上下文)正在成为新的主流方向。

七、结尾总结

本文核心知识点速查:

| 知识点 | 关键结论 |

|---|---|

| 检测 vs 分割 | 检测用矩形框“圈出”结节位置,分割用像素级掩码“描绘”结节轮廓 |

| U-Net核心 | 编码器-解码器 + 跳跃连接 = 兼顾语义理解与空间细节 |

| BI-RADS分级 | 4类是“灰色地带”,AI可帮助4A类中约18.6%的良性病变避免不必要活检 |

| 临床证据 | AI支持乳腺钼靶筛查敏感度80.5% vs 传统双读73.8%(MASAI试验) |

| 代码重点 | 组合损失(BCE + Dice) + ROI提取后分类 |

易错点提醒:

分割任务中不要用纯交叉熵损失——结节区域极小,模型会学到“全预测背景也能得到高准确率”的伪最优解

推理时不要直接将全图输入分类器——应先利用分割掩码提取ROI,否则背景噪声会严重干扰分类

面试高频考点:U-Net结构细节、检测与分割的区别、BI-RADS分级含义、类别不平衡解决方案

下期预告:《乳腺结节AI助手的多模态融合技术——钼靶+超声+MRI的跨模态对齐与联合诊断》,我们将深入探讨如何构建多模态Transformer融合架构,并附完整代码实现。

参考文献(2026年最新发表):

Huang K A et al. Size-Dependent Performance of Abnormal-Focused U-Net Segmentation, Cureus, Mar 2026-1

Zhu Y et al. UltrasoundAgents: Hierarchical Multi-Agent Evidence-Chain Reasoning, arXiv:2603.10852, Mar 2026-2

Gommers J et al. MASAI trial: AI-supported mammography vs standard double reading, The Lancet, Jan 2026-12

Interpretable AI system reduces false-positive MRI diagnoses, Nature Communications, Feb 2026-11

AI in Breast Imaging Market Report 2026, Research and Markets, Jan 2026-32

扫一扫微信交流

扫一扫微信交流